雲端以外的無聲革命

隨著 CES 2026 逐漸淡出人們的視線,真正的焦點並非那些炫目的消費電子產品,而是正在悄悄發生、影響深遠的硬體革命,它正在重塑企業人工智慧。儘管人工智慧領域的新聞長期以來都被大規模的雲端模型所主導,但一場決定性的轉變正在悄悄發生。優化的本地人工智慧硬體、先進的離線優先框架以及日益增長的資料主權要求,共同推動本地部署人工智慧在 2024 年從小眾替代方案轉變為關鍵策略。

對於正在考慮節後硬體升級的企業而言,這不僅是一次簡單的更新換代,更是一次建構具有競爭力、韌性強且真正自主的智慧基礎設施的良機。本文將探討為何本地運行模型變得比以往任何時候都更加重要,以及近期技術進步如何使之不僅可行,而且具有戰略意義。

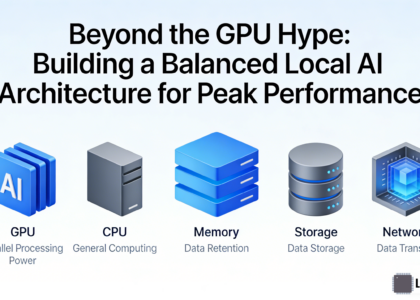

硬體革命:從資料中心到桌面級效能

2026 年國際消費電子展 (CES) 展示了業內人士數月以來一直期待的成果:消費級硬體如今已能實現幾年前需要伺服器機架才能實現的功能。 NVIDIA 最新的 RTX 50 系列顯示卡配備了專用的 AI 張量核心,針對局部推理進行了優化;而 AMD 的 Ryzen AI 800 系列處理器則集成了神經網路處理單元 (NPU),能夠高效運行數十億參數模型。

但真正的重點並非硬體規格——而是圍繞這套硬體發展的成熟優化生態系統。以本地人工智慧部署工具的進步為例:

- Ollama 2026 版:現已支援硬體感知模型量化,可自動針對特定 GPU/CPU 組合進行最佳化,在精確度損失最小的情況下,將模型大小減少 40-60%。

- llama.cpp 增強功能:CUDA 和 ROCm 後端可充分利用 GPU 的每一分潛力,並針對 NVIDIA 的最新架構進行了特別最佳化。

- Windows AI Stack:微軟將本機 AI 運行時間深度整合到 Windows 12 中,為企業應用程式創建了無縫環境。

這些進展意義重大,因為它們從根本上改變了人工智慧部署的經濟模式。過去需要六位數基礎設施投資才能實現的功能,現在只需不到5,000美元的工作站即可運作。

推動本地人工智慧轉型的五大戰略要務

- 數據主權與監理合規

全球資料保護法規超越了GDPR的範疇。歐盟2025年人工智慧法案、中國的《資料安全法》以及金融和醫療保健等行業的特定法規都日益強調資料在地化。基於雲端的人工智慧跨境處理敏感資訊會帶來難以承受的合規風險。

例如:一家歐洲醫療保健供應商使用本地人工智慧進行病患記錄分析,既符合醫療隱私法,又符合人工智慧法規,而基於雲端的替代方案則會面臨難以克服的法律障礙。

- 無延遲即時處理

某些應用程式根本無法容忍與雲端伺服器的往返延遲。工業自動化、金融交易演算法和即時翻譯系統需要低於 20 毫秒的回應時間——對於許多地理位置而言,雲端架構在物理上是無法實現的。

- 可預測的成本結構

雲端人工智慧服務採用按需付費模式,其成本會隨著使用量而不可預測地增長,而本地人工智慧則將成本從營運支出轉變為可預測的資本支出。對於持續的人工智慧工作負載,大多數中型部署方案的損益平衡點現在可在 12-18 個月內實現。

- 增強安全態勢

每次資料傳輸到雲端都存在潛在漏洞。本地人工智慧透過將敏感資料保留在組織邊界內,最大限度地減少了攻擊面。在人工智慧驅動的複雜網路威脅時代,這種遏制策略提供了縱深防禦優勢。

- 營運韌性

當關鍵模型在本地運行時,自然災害、區域性網路中斷或雲端服務中斷不再會導致人工智慧功能完全喪失。這種復原能力在業務連續性計劃中日益受到重視。

實際應用:2024-2025 年發生了哪些變化?

本地人工智慧的理論優勢並不新鮮——改變的是實際應用。幾項關鍵進展消除了以往的障礙:

模型效率突破:

- 專家混合架構(MoE):更小、更專業的模型,僅激活相關的神經通路,在保持能力的同時,將運算需求降低 70% 以上。

- 專家架構(MoE):更小、更專業的模型,只需啟動相關的神經功能,在維持能力的同時,將侵犯需求降低70%以上。 footprints

- 架構專業化:專為垂直領域應用(法律、醫療、工程)設計的模型,儘管規模較小,但在領域任務上卻優於一般模型。

工具成熟度:

| # Simplified 2026 local deployment vs. 2023 approach

# 2023: Complex, fragile deployment import torch from transformers import AutoModelForCausalLM model = AutoModelForCausalLM.from_pretrained(“big-model”) # … extensive optimization code needed # Result: Often unstable, required specialized expertise

# 2026: Hardware-optimized, one-command deployment ollama run llama3.2:latest –gpu –optimize-for “rtx5090” # Automatic hardware detection and optimization # Result: Production-ready in minutes |

企業管理生態系:

現代本地 AI 並非只是在單一機器上運行單一模型。 LocalAI Orchestrator 和 On-Prem AI Manager 等解決方案提供:

- 跨設施的集中式模型部署和版本控制

- 使用情況監控和成本分配

- 自動模型更新和安全性補丁

- 混合部署管理(在本地端和雲端之間拆分工作負載)

假期後硬體升級指南:建構本地人工智慧基礎架構

對於計劃進行硬體更新換代的企業,請考慮以下配置:

| 應用場景 | 推薦配置 | 價格範圍 | 主要功能 |

| 個人開發者 | RTX 5080 + 64GB RAM + Ryzen AI 8900X | $3,500-$4,500 | 以可用速度運行 70B 參數模型 |

| 小型團隊伺服器 | 雙 RTX 5090 + 128GB RAM + Threadripper Pro | $8,000-$12,000 | 使用 7B-40B 型號為 20 個以上並發用戶提供服務 |

| 部門部署 | NVIDIA AI 工作站 (RTX 6000 Ada x2) + 256GB RAM | $15,000-$25,000 | 同時訓練多個大型模型,進行微調 |

| 邊緣工業 | 配備 RTX 5000 行動顯示卡的加強型 AI 設備 | $7,000-$10,000 | 工廠車間部署,即時品質控制 |

Critical Implementation Insights:

- 記憶體為王:除了顯示卡規格之外,系統記憶體直接決定了你能運行哪些機型的顯示卡。對於高強度工作,至少需要 64GB 內存,建議使用 128GB。

- 儲存至關重要:現代人工智慧工作流程涉及模型間的快速切換。 NVMe Gen5 儲存可顯著縮短載入時間。

- 散熱需求:持續的AI推理會產生持續的熱負荷,通常超過遊戲或傳統運算工作負載。因此,需要據此規劃散熱解決方案。

- 軟體考量:硬體只是成功的一半。預算中還需包含企業級人工智慧管理軟體以及初始部署所需的諮詢服務。

未來之路:2026 年策略中的本地人工智慧

隨著我們邁入2026年,預計以下幾個趨勢將加速本地人工智慧的發展:

- 垂直產業專用硬體:垂直產業專用硬體:針對特定產業優化的專用晶片(醫療影像分析、金融風險建模)

- 垂直產業專用硬體:針對特定產業優化的專用晶片(醫療影像分析、金融風險建模)

- 邊緣到雲端編排:智慧工作負載分配,可根據敏感度、緊急性和成本因素在本地和雲端之間動態切換。

- AI原生作業系統:從根本上圍繞AI工作流程重新設計的系統,而不是將AI功能改造到現有架構上。

結論:建構自主智能

2026 年的人工智慧格局將呈現明顯的分化:一條路徑繼續沿用以雲端為中心的模式及其相關依賴性,而另一條路徑則直接在組織內部建構自主智慧能力。對企業而言,這不僅是一個技術決策,更是一個影響競爭力、韌性和合規性的策略定位。

硬體進步、軟體最佳化和監管壓力三者匯聚,為企業建構本地人工智慧能力創造了一個獨特的契機。那些利用節後升級季夯實基礎的企業,到2026年將擁有僅靠雲端訂閱無法複製的能力——他們將擁有自己的智慧基礎設施。

正如CES 2026所展示的那樣,工具已經就緒。問題不再是本地人工智慧是否可行,而是各組織機構如何以最快的速度部署它,從而在這個分散式、自主智慧的新時代獲得先發優勢。

LocalArch AI 協助企業設計和部署自主 AI 基礎架構。聯絡我們,以取得針對您本地 AI 準備的個人化評估和實施路線圖。