人工智慧工作站中隱藏的瓶頸

026 年國際消費電子展 (CES) 的焦點顯而易見:NVIDIA 最新的 RTX 50 系列 GPU 和 AMD 的全新 Ryzen AI 處理器承諾為本地 AI 帶來驚人的 teraflops 運算能力。然而,當業界對強大的運算能力驚嘆不已時,無數部署方案中卻暴露出一個關鍵缺陷。今年展會的真正焦點並非更快的晶片,而是預裝「AI PC」解決方案 成本的飆升 ,這些方案通常將頂級 GPU 與性能羈弱的配套硬體捆綁在一起。投資旗艦級 GPU 卻不搭配均衡的架構,就好比把一級方程式賽車引擎裝進裝有自行車輪胎和踏板車變速箱的車架裡;你永遠無法發揮它的潛力,投資也基本打了水漂。

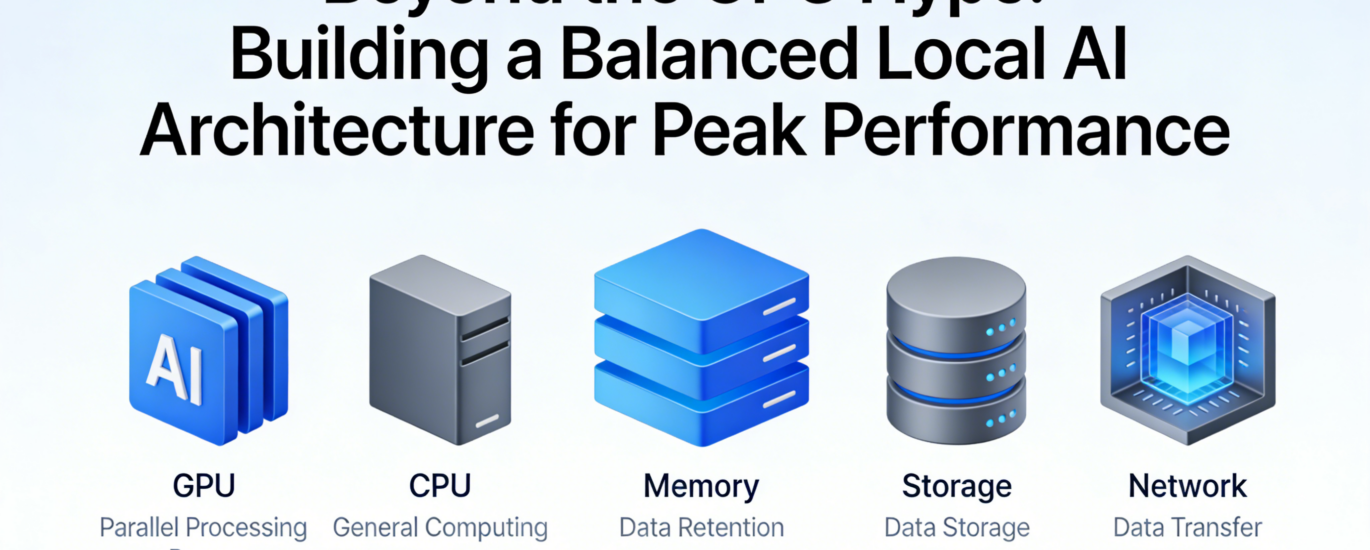

在 LocalArch.ai,我們建構本地部署解決方案的實踐經驗始終表明,AI 的巔峰性能並非單打獨鬥,而是一場和諧的交響樂。真正的系統效率——模型運作迅速、工作流程流暢、整體擁有成本最小化——只有在 GPU、記憶體、儲存和 CPU 精心協調的情況下才能實現。本文將超越對 GPU 的過度吹捧,提供建構均衡的本地 AI 架構的實用藍圖,從而確保長期可靠的巔峰效能。

關於「僅GPU升級」的迷思

人們普遍誤解人工智慧效能與GPU成本呈線性關係。這導致系統效能失衡,例如,一塊價值2500美元的GPU會因記憶體不足或儲存速度慢而成為瓶頸,造成令人沮喪的效能瓶頸。

真正的瓶頸:

- 記憶體不足:現代大型語言模型 (LLM) 對記憶體的需求量極大。載入一個 700 億參數的模型很容易需要 40GB 以上的記憶體。如果系統記憶體不足,模型根本無法加載,或者會強制進行大量的磁碟交換,從而嚴重影響速度。 GPU 只能閒置,等待資料載入。

- 儲存 I/O 瓶頸:微調模型或處理大型資料集需要讀取數百萬個檔案。標準的 SATA SSD 可能會成為嚴重的瓶頸,導致資料管道停滯,因為 GPU 需要等待下一批訓練資料。

- CPU效能不足:雖然GPU負責模型推理(預測),但CPU對於資料預處理、管道管理以及運行編排框架(例如Ollama或vLLM)至關重要。效能不足的CPU無法快速地為GPU提供足夠的資料。

正如我們一位客戶在建立內部聊天機器人時發現的那樣,從僅使用頂級GPU轉向均衡的系統設計,其有效吞吐量提升了三倍。關鍵不在於提升GPU效能,而是消除圍繞GPU的瓶頸。

均衡架構框架:CPU、RAM 和儲存作為效能倍增器

建立一個平衡的系統需要將每個組件視為人工智慧工作流程中的積極參與者。以下是如何思考每個要素:

- 系統記憶體:必不可少的過渡平台

把記憶體想像成GPU的即時高速工作站。它儲存著正在使用的模型權重、正在處理的資料以及中間結果。

- 經驗法則:系統記憶體的最小容量應為顯示卡顯存容量的 1.5 到 2 倍。例如,對於 24GB 記憶體的顯示卡,建議至少配備 32-48GB 的系統記憶體。對於雙顯示卡配置或 48GB 以上的專業顯示卡,建議配備 128GB 或以上的系統記憶體。

- 速度至關重要:充分利用 DDR5 或最新標準。更快的記憶體速度可以降低 CPU 為 GPU 準備資料時的延遲。

- 儲存:傳送帶

您的儲存磁碟機就像傳送帶,將原料(資料集)傳送到車間,並將成品(訓練好的模型)歸檔。

- NVMe 不可或缺:對於主磁碟機(作業系統、應用程式、活動資料集),高速 PCIe 5.0 NVMe SSD 至關重要。它能確保近乎瞬時的模型載入和快速的資料存取。

- 分層策略:實施成本效益高的分層策略:

- 1 級(NVMe SSD):1 級(NVMe SSD):用於活躍專案、模型儲存庫和您的工作環境。

- 二級(高容量 SATA SSD/HDD):用於冷儲存已歸檔的資料集、日誌和備份模型。

- CPU:管弦樂團指揮

CPU 不會運行模型,但它管理其他一切:將資料從記憶體載入到 RAM 中,執行 AI 框架軟體,以及處理系統任務。

- 核心數量比單純的時脈頻率更重要:現代人工智慧框架都是多執行緒的。擁有高核心/執行緒數的CPU(例如AMD Ryzen 9/Threadripper或Intel Core i9/i7)能夠確保資料流暢傳輸。

- PCIe 通道支援:確保您的 CPU/平台提供足夠的 PCIe 通道,以使您的 GPU、NVMe 驅動器和其他附加卡能夠全速運行而不會發生爭用。

滿足不同需求的實用配置

以下是針對不同使用情境和預算的均衡配置,旨在防止瓶頸並最大限度地發揮您的 GPU 投資效益。

| 實例與目標 | 平衡配置藍圖 | 關鍵職效原理 |

| 開發人員/研究員 運行並微調 7B-40B 參數模型。 |

GPU: RTX 5080 (16-24GB VRAM) RAM: 64-96GB DDR5 Storage: 2TB PCIe 5.0 NVMe SSD CPU: 12-core/24-thread (e.g., Ryzen 9 8900X) |

RAM 為大型模型和資料批次提供了充足的運行空間。高速 NVMe 固態硬碟消除了模型載入和資料集迭代過程中的等待時間。 |

| 小型團隊/部門伺服器 為 10-20 位使用者提供多個精細調整的模型。 |

GPU: Dual RTX 5090 or RTX 6000 Ada (48GB total) RAM: 128-192GB ECC DDR5 Storage: 4TB NVMe SSD (Primary) + 16TB SATA SSD (Data) CPU: 16-core/32-thread (e.g., Threadripper Pro) |

ECC記憶體確保持續運作的穩定性。高核心數可處理並發請求。分層儲存兼顧速度和容量。 |

| 邊緣推理設備 在製造業、零售業或偏遠地區應用即時人工智慧。 |

GPU: Ruggedized RTX 5000 Mobile / Embedded AGX Orin RAM: 32-64GB (soldered for durability) Storage: 1-2TB high-endurance industrial NVMe CPU: Matched mobile/embedded platform |

我們注重可靠性、能源效率和耐用性。工業級組件能夠承受振動、溫度波動和全天候運作。 |

實施您的平衡系統:逐步指南

- 明確你的主要工作負荷:明確你的主要工作負荷:是推理(運行模型)、微調(客製化模型)還是訓練(從頭開始建立)?這將決定你選擇什麼樣的GPU以及支援組件的規模。

- 首先確定模型:確定所需運行模型的參數大小。以此計算所需的最小顯存和系統記憶體。

- 從顯示卡出發建構:選擇一款滿足您顯存與速度需求的顯示卡。然後,選擇一款能夠全速支援此顯示卡(使用完整的 x16 PCIe 插槽)且擁有足夠插槽/高速介面以滿足您的記憶體和儲存需求的 CPU 和主機板平台。

- 優先考慮高速儲存:預算充足,選擇一款高品質、高吞吐量的 NVMe SSD 作為主硬碟。這是最具性價比的性能升級方案之一。

- 散熱與電源規劃:配備高階組件的均衡系統會產生大量熱量並消耗大量電力。因此,請務必投資一套強大的散熱解決方案(包括CPU和機箱的空氣流通)以及高效且功率匹配的電源(PSU)。

結論:建構主權與績效架構

實現高效的本地人工智慧並非在於購買CES上最昂貴的單一元件,而是建構精心設計的、整體性的架構。均衡的系統能夠確保每一分錢都花在強大的GPU上,從而帶來更快的運行速度、更流暢的工作流程以及更低的長期總體擁有成本——這些正是 LocalArch.ai所倡導的核心原則。

拋開對GPU的盲目追求,專注於系統級的均衡發展,你構建的不僅僅是一台高速計算機,而是一個自主的AI平台,它能夠根據你的需求,在你自己的環境和模式下,提供可靠、安全且高性能的智能。

準備好建構一個能夠充分發揮其潛力的均衡本地AI架構了嗎? LocalArch.ai 的專家提供量身訂製的AI基礎設施諮詢和設計服務,協助您選擇並整合適合特定工作負載和業務目標的元件。聯絡我們,建立實現卓越效能的基礎架構。